Introdução

O erro humano é mencionado, recorrentemente, como a principal causa para a ocorrência de situações críticas dentro das organizações. Este termo está também associado a falhas e maus resultados. Em diversos setores de atividade o erro humano é apresentado como tendo contribuído para um número significativo de acidentes: por exemplo, no ramo da aviação estima-se que 70% destes eventos se devem a erros da tripulação e nas cirurgias hospitalares os erros dos anestesistas variam entre 70% a 75% dos acidentes. Em muitas outras áreas de atividade as percentagens são ainda mais elevadas. É precisamente por isso que está largamente disseminada a ideia de que o erro humano é um problema grave para as organizações (Woods et al., 2010). Perante estes números, parece fazer sentido ter como prioridade primordial a identificação dos erros humanos, tendo em vista a sua redução. Esta ideia pressupõe que a diminuição da frequência de erros será acompanhada, obrigatoriamente, por uma redução dos acidentes. Todavia, a realidade pode não ser tão óbvia quanto aparenta (Amalberti, 2016).

As falhas e acidentes atribuídos ao erro humano parecem demonstrar a fraca fiabilidade do fator humano.1 Por isso, a suposta solução para esconjurar este problema passa por ampliar a vigilância, a disciplina e o controlo hierárquico sobre os prevaricadores (regra geral este ónus recai sobre os trabalhadores operacionais), aumentar o número e a profundidade das normas, regras, procedimentos ou instruções de trabalho (apertando a malha sobre o trabalho vivo, através da aplicação de alguns princípios da “qualidade total”) e criar mais automatizações (limitando ao máximo a intervenção humana). Contudo, esta estratégia para controlar o fator humano está muito longe de conseguir alcançar os fins desejados. Explicar os motivos desta situação e debater outros caminhos para abordar o erro humano é o objetivo central deste trabalho, a partir de quatro perspetivas que dominam a literatura científica sobre o tema. Atendendo a que os autores das quatro abordagens mantêm um diálogo próximo, e que se influenciam entre si, as suas diferenças são residuais e as perspetivas que defendem complementam-se sem qualquer disparidade estrutural significativa. Todos eles defendem que, além dos erros humanos, são sobretudo os dispositivos administrativos, técnicos e organizacionais que devem ser avaliados na sua relação com o acidente ou incidente.

A diversidade conceptual do erro

O erro humano é uma entidade omnipresente. É utópico tentar idealizar um mundo sem erros. Todos nós erramos várias vezes por dia, algumas delas sem nos apercebermos de forma imediata. A esmagadora maioria dos nossos erros é insignificante e não acarreta qualquer problema digno de registo. Imagine que se enganou a digitar o código do multibanco, a password do computador ou o botão do elevador para o piso pretendido; rapidamente deteta e corrige o erro e em situações deste tipo apenas perdeu alguns segundos do seu tempo. Porém, erros tão simples e “insignificantes” como aqueles que acabei de mencionar, quando cometidos em contextos ou ambientes perigosos (como por exemplo, em organizações complexas de alto risco), podem acarretar consequências desastrosas. Isto parece indiciar que o grande problema talvez não esteja tanto no erro em si mesmo (dado que é impossível eliminá-lo em absoluto), mas no contexto em que ele ocorre. Idealize o seguinte cenário numa organização de risco elevado: um maquinista de metro transporta diariamente milhares de passageiros. Dentro das suas funções principais está a condução do comboio e a abertura e fecho das portas nas estações ao longo do percurso. Sempre que chega a uma estação o maquinista pára o comboio e abre as portas (permitindo a entrada e saída de passageiros), depois fecha as portas e conduz até à estação seguinte. Se esse trabalhador já tiver vários anos de serviço, seguramente terá realizado aquela ação (parar o comboio e abrir as portas) milhares de vezes. Essa é a regra que se transformou em hábito, ou seja, o processo está totalmente automatizado no seu corpo e na sua mente, fruto da rotinização. Agora imagine uma situação bem menos comum no seu quotidiano laboral (que por hipótese só ocorre pontualmente): o maquinista tem à sua frente um sinal vermelho, dentro do túnel, que o obriga a parar. Se ele ativar indevidamente o seu automatismo de parar o comboio e abrir a porta (essa é a regra habitual), isso significa que algum passageiro que esteja encostado à porta possa cair ou, se for em hora de ponta, várias pessoas possam cair. A morte de algum passageiro é uma conjetura plausível, quer devido à queda, quer por eventual eletrocussão. Este erro, decorrente da rotinização do trabalho do maquinista, não é muito distinto dos erros indicados anteriormente (código do multibanco, password do computador ou botão do elevador); porém, as consequências podem ser substancialmente mais graves. O âmago do problema não é tanto o erro em si (o qual é tendencialmente omnipresente em algumas das nossas ações), mas o contexto em que ele ocorre, principalmente quando o contexto não é resiliente ao erro.

Freud (1974) afirmava que alguns atos falhados (um tipo específico de erro) são produto do nosso inconsciente. Também afirmava que algumas pessoas são mais propensas a cometer erros, devido aos seus traços particulares. Donald Norman (1988) divide os erros em dois tipos: cognitivos e aspetos motores (ação física). Segundo a perspetiva de Senders e Moray (1991) o erro deve ser entendido como algo que foi feito de modo: 1) não pretendido pelo autor; 2) não desejado por um observador externo ou não adequado a partir de um conjunto de regras; 3) a levar a tarefa ou o sistema para fora dos seus limites aceitáveis. Assim, o erro humano está relacionado com desvios (ou falhas) perante determinadas intenções, metas ou objetivos pré-definidos. A definição de erro está relacionada com um fim não alcançado ou um alvo/propósito que não foi atingido. Para Daniellou et al. (2010) o erro jamais é voluntário, pois a pessoa que erra não tinha intenção de se afastar da sua referência, seja ela uma norma, uma regra ou um objetivo. Os alegados “erros intencionais” devem se definidos como violações. Porém, esta conceção sobre o erro está longe de ser uniforme e consensual na literatura sobre o tema. Há múltiplas formas para definir e classificar os erros; isto significa que diferentes taxonomias servem diferentes propósitos.

Definir uma determinada ação ou inação como erro implica sempre uma valoração, um juízo de valor, um julgamento, em suma, uma apreciação. Não há como qualificar ou quantificar um erro sem recorrer a um processo de avaliação (independentemente do seu maior ou menor grau de precisão). Todavia, qualquer avaliação incorpora sempre uma certa margem de subjetividade, ou seja, também ela não está imune ao erro ou à falha. Na verdade, qualquer atividade humana é vulnerável ao erro. James Reason define o erro do seguinte modo: “error will be taken as a generic term encompass all those occasions in which a planned sequence of mental or physical activities fails to achieve its intended outcome, and when these failures cannot be attributed to the intervention of some change agency” (Reason, 1990, p. 9).

Na sua forma mais simples, o erro humano pode ser definido como uma ação inadequada ou uma falha na execução de uma determinada ação. Embora esta definição pareça extremamente simplista, a verdade é que ela está envolta em múltiplas dificuldades. Por isso, para uma melhor compreensão do erro humano foram gizadas várias definições de erro, categorias, classificações, perspetivas, teorias e modelos. Ainda de acordo com um nível relativamente básico de classificação, é proposta uma distinção entre dois tipos de erros: a omissão e a comissão. Os erros de omissão estão circunscritos àquelas situações em que o indivíduo falha na sua ação, nomeadamente falha ou esquece-se de executar uma determinada ação. Os erros de comissão são aqueles casos em que uma pessoa executa uma ação incorretamente, como por exemplo pressionar o botão errado (do elevador) ou executar a ação necessária, mas na hora ou na sequência errada.

De certo modo, o erro humano representa um descompasso entre as pressões e imposições de um sistema operacional e aquilo que o ser humano efetivamente faz. Rasmussen, Duncan e Leplat (1987) definiram o erro humano como um ato que é contraproducente em relação às intenções ou objetivos das pessoas. Woods et al. (2010) apresentam o erro como uma variedade específica do desempenho humano que é tão clara e significativamente abaixo do padrão esperado que, visto em retrospetiva, parece não haver dúvidas de que - no momento em que o ato foi cometido ou omitido - deveria ter sido considerado como algo sub-padrão. Segundo Reason (1997) o erro humano pode ser compreendido como a falha de ações planeadas para atingir determinado objetivo desejado, sem a intervenção de algum evento inesperado. Aqui, a menção ao inesperado é importante, pois exclui o fator “sorte”. Por exemplo, quando alguém está a jogar golfe, dá uma tacada e a bola vai diretamente para o buraco, o objetivo foi atingido e não houve erro. No entanto, se ao dar outra tacada, a bola bater numa árvore e depois cair no buraco, o objetivo foi atingido, mas a tacada, ainda assim, foi errada. A bola caiu no buraco apenas por uma questão de sorte. Errar ou não errar na obtenção da meta desejada é, por vezes, uma questão de sorte.

Quatro perspetivas sobre o erro humano

Rasmussen e o modelo SRK

A primeira perspetiva que pretendo apresentar foi preconizada por Jens Rasmussen (1983). O autor concebeu o modelo SRK (Skills, Rules, Knowledge), que distingue três modos de comportamento, aos quais estão associadas tipologias específicas de erros. Cada um dos níveis dentro da estrutura da SRK define um nível diferente de controlo cognitivo ou desempenho humano.

1 - No nível baseado em habilidades (skill-based behaviour) as ações estão automatizadas perante determinados estímulos. O modo de funcionamento é essencialmente subconsciente e predominam os erros de rotina. Quando executamos alguma tarefa de forma frequente e rotineira, criamos certos automatismos (fruto da habituação). A rotinização ou habituação oferece vantagens e desvantagens. Quando fazemos alguma atividade pela primeira vez, isso exige que estejamos mais concentrados e com um nível superior de atenção (pense, por exemplo, na primeira vez que conduziu um automóvel; possivelmente foi difícil e exigiu um grau de atenção muito elevado antes de executar qualquer movimento). Depois de algum tempo de condução tudo ficou facilitado; foi a habituação a fazer o seu trabalho. Tarefas novas exigem normalmente mais esforço, concentração e um maior consumo de energia e/ou disponibilidade mental. Por isso, o desempenho de novas tarefas torna-se normalmente mais cansativo ou fatigante. Após executar determinadas tarefas várias vezes, ganhamos automatismos e rapidez que, por sua vez, nos exige menos esforço e energia. Este é o lado positivo da habituação ou rotinização. Contudo, o lado negativo é o seguinte: como passamos a funcionar com um menor grau de atenção, vigilância e esforço, ficamos mais vulneráveis a cometer mais erros. Neste nível ocorrem essencialmente erros de execução, tal como aconteceu com o maquinista de metro supramencionado.

2 - O nível baseado em regras (rule-based behaviour) aplica-se perante situações conhecidas, em que as regras existentes já demonstraram ser adequadas para coordenar sub-rotinas comportamentais dos indivíduos. Por exemplo, em contexto organizacional mobilizamos as regras profissionais a partir de uma relação de causalidade (se isso, então aquilo). Este modo de atuação permite ganhar pragmatismo e eficiência em relação ao modo anterior (habilidades). Se algum aprendiz de cozinha segue a receita de um livro de culinária, a aplicação de todas as regras e instruções permite uma ação eficaz sem o cozinheiro necessitar de se questionar sobre o porquê de fazer aquela sequência de passos. Simplesmente segue as instruções que permitem cozinhar uma refeição deliciosa. Se uma situação laboral sofrer um desvio da sua normalidade, podemos recorrer à aplicação de regras armazenadas na memória, de modo a tentarmos reestabelecer a normalidade. Neste nível, os erros estão normalmente relacionados com a classificação ou com o reconhecimento específico das situações e com a capacidade de saber aplicar a(s) respetiva(s) regra(s) correta(s). Segundo Rasmussen (1983)

The boundary between skill-based and rule-based performance is not quite distinct, and much depends on the level of training and on the attention of the person. In general, the skill-based performance rolls along without the person’s conscious attention, and he will be unable to describe how he controls and on what information he bases the performance. The higher level rule-based coordination is generally based on explicit know-how, and the rules used can be reported by the person [Rasmussen, 1983, p. 259].

3 -No nível baseado em conhecimentos (knowledge-based behaviour) mobilizamos tudo o que sabemos para compreender e dominar uma situação não rotineira (normalmente única ou desconhecida), recorrendo a uma abordagem tipicamente racional, similar àquela que é aprendida no meio académico. Por exemplo, num cenário de emergência não concebido anteriormente (logo não treinado), os indivíduos não têm regras conhecidas para aplicar. O nível de comportamento baseado em conhecimentos consiste na procura deliberada e sequencial de passos para encontrar uma solução. Este nível é lento e trabalhoso, pois requer atenção consciente e focada. É algo que requer a utilização do nosso Sistema 2 de pensamento (Kahneman, 2012). Os erros, no nível de comportamento baseado em conhecimentos, são tipicamente erros decorrentes de limitações de recursos ou de conhecimentos incompletos ou incorretos associados aos processos de tomada de decisão.

During unfamiliar situations, faced with an environment for which no know-how or rules for control are available from previous encounters, the control of performance must move to a higher conceptual level, in which performance is goal-controlled and knowledge-based. In this situation, the goal is explicitly formulated, based on an analysis of the environment and the overall aims of the person [Rasmussen, 1983, p. 259].

Cada um destes níveis cria oportunidades de erros diferentes (erros de rotina, regras ou conhecimento). Se a rotina já não funciona e o caminho em direção ao objetivo está bloqueado, o indivíduo poderá passar para o modo baseado nas regras. Se, mesmo assim, as regras conhecidas não forem uma solução, então será acionado o modelo baseado em conhecimentos. Esta parece ser normalmente a sequência do nosso pensamento quando as estratégias para resolver os problemas deixam de funcionar. Estatisticamente, os erros de rotina correspondem a cerca de 80% do total dos erros cometidos. Os erros de ativação de regras correspondem a cerca de 15% do total dos erros. Já os erros por falta de conhecimento correspondem a menos de 5% do total dos erros (Amalberti, 2016, p. 50). Sabemos que os erros de rotina são impossíveis de eliminar em absoluto, por isso, mais tarde ou mais cedo acabaremos por “insistir no erro”.

Reason e o modelo dos atos inseguros

A segunda perspetiva que irei mencionar foi idealizada por Reason (1990), com forte inspiração no modelo SRK (apresentado anteriormente). Através da figura 1 podemos aferir a forma como o autor conceptualiza esquematicamente a perspetiva dos atos inseguros.2 Este modelo concebe o erro humano/atos inseguros a partir de ações intencionais e não intencionais, de acordo com a seguinte tipologia: erros, lapsos e deslizes (mistakes3, lapses and slips4).

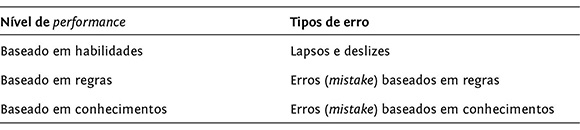

No quadro 1 podemos encontrar a correspondência entre o nível de desempenho ou performance e o tipo de erro correspondente. Os lapsos e deslizes ocorrem no nível de comportamento humano baseado em habilidades (regra geral, antes de ser feita a identificação de um problema) e o tipo de falha está normalmente categorizado como sendo de monitorização. Os erros baseados em regras e os erros baseados em conhecimentos surgem habitualmente após um problema ter sido identificado. O tipo de falha encontra-se no âmbito da tentativa de resolução desses problemas.

Reason e Hobbs (2003) afirmam que a familiaridade com determinadas situações pode conduzir o nosso comportamento através de certos automatismos de rotina. A experiência em executar determinadas tarefas mais simplificadas pode dar origem a que os trabalhadores tendam a reduzir o seu esforço mental, atuando como se tivessem acionado uma espécie de piloto automático. Assim, os nossos saberes de rotina (baseados na habituação) podem conduzir as nossas ações e isto pode ser particularmente perigoso, visto que podemos atuar de forma contrária ao que pretenderíamos (caso estivéssemos mentalmente conscientes dessas mesmas ações). Por exemplo, se um trabalhador de uma linha de montagem é excecionalmente confrontado com uma nova situação de trabalho ele até pode compreendê-la, mas o designado reflexo condicionado anterior (automatismo ou rotinização) não desaparece e isso pode explicar alguns tipos de erros.

Há vários tipos de erro, ou melhor, os erros que cometemos têm origens distintas. A diferenciação de Reason (2008) relativa aos vários tipos de erros pode ajudar a compreender quais serão as medidas preventivas mais adequadas para tentar colmatar esses mesmos erros. Teoricamente, todos os erros são evitáveis, mas, na prática, é utópico pensarmos que alguma vez os podemos prevenir ou evitar a todos. O mundo real é, regra geral, bastante diferente daquilo que nós gostaríamos que fosse ou do que imaginamos. Talvez ainda tenhamos dificuldade em conviver e aceitar fatores como a incerteza, os múltiplos riscos, as contingências, as relações não lineares entre diversas situações, a complexidade de determinadas interações, a aleatoriedade, o inesperado, o indeterminado e por aí adiante. Na verdade, parece que somos avessos ao “caos” de inter-relações que nos rodeia e resistimos a aceitá-lo com pragmatismo. Mas isso é também um dos fatores que nos conduz aos erros e às falhas. O erro humano está profundamente articulado entre o contexto em que ocorre e o nosso sistema de processamento mental e cognitivo. Neste último caso, há vários vieses e simplificações produzidas pela nossa mente (Dobelli, 2011; Kahneman, 2012). Num estudo clássico realizado por Tversky e Kahneman (1974), é afirmado que quando as pessoas têm de tomar decisões sob cenários de incerteza, tendem a recorrer às heurísticas. Na maior parte do tempo as heurísticas são úteis, contudo, em determinados momentos podem conduzir--nos a erros severos e sistemáticos. Afinal, segundo a perspetiva de Herbert Simon (1955), a nossa racionalidade é limitada.

Reason (1990; 1997) crítica fortemente a maioria das estatísticas que apontam para que a principal causa dos acidentes seja atribuível ao erro humano. No seu entender, o designado erro humano será mais uma consequência e não tanto uma causa explicativa para os acidentes. Os erros são moldados e provocados a montante por fatores organizacionais, incluindo a organização do trabalho. O mesmo autor defende que a segurança das organizações não deve depender somente dos fatores humanos (como já foi referido, são falíveis), deve ter vários tipos de barreiras (designadas “defesas em profundidade”). Esta estratégia de prevenção deixa subjacente que os sistemas devem ser concebidos de maneira a que quando ocorrerem erros humanos estes não possam dar origem a acidentes. Para isso é necessário que a organização dê liberdade aos trabalhadores para comunicarem os erros (sem receberem penalizações), de modo a que esses mesmos erros sejam incorporados na gestão da prevenção. Porém, é pertinente lembrar que não há estratégias infalíveis (e esta também não é exceção).

De forma categórica, Reason (2000) afirma que não podemos mudar a condição humana, mas podemos mudar as condições em que os humanos trabalham. Quando se aborda a temática dos fatores humanos ou erro humano, há a ilusão de que as pessoas podem sempre decidir entre o fazer certo ou errado (infelizmente esse pressuposto está errado). É essa ilusão (de livre arbítrio) que tende a transformar-se rapidamente na responsabilização, culpabilização e penalização do alegado infrator.5 O debate sobre o erro humano e a consequente culpabilização do “prevaricador” carece ainda de uma longa reflexão, entre outros aspetos, porque culpabilizar os outros é normalmente mais gratificante.

At an individual level, we gain a good deal of emotional satisfaction from blaming someone - rather than something - when things go wrong. And, at the organizational level, there are obvious financial and legal benefits in being able to uncouple individual fallibility. Either way, there are advantages in being able to limit culpability to specific people [Reason, 1997, p. 232].

Dekker e as duas perspetivas do erro humano

A terceira perspetiva que pretendo expor é preconizada por Dekker (2006). Este autor concebe um dos debates mais recentes em torno do erro humano e apresenta duas perspetivas diametralmente opostas: a perspetiva antiga e a perspetiva moderna. O quadro 2 indica de forma resumida alguns dos principais pressupostos destas duas abordagens.

Na visão antiga, o erro humano é tratado como a principal causa para a maioria dos acidentes. Os sistemas são considerados seguros e a principal ameaça à segurança sistémica é a (in)fiabilidade humana. O progresso da segurança é obtido pela proteção dos sistemas contra a falta de fiabilidade humana, por uma maior disciplina, pelo aumento do rigor na seleção dos trabalhadores e pela ampliação dos procedimentos. Por outras palavras, a (in)fiabilidade humana é trocada pela fiabilidade técnica, pois o fator humano é visto como o elemento indisciplinado da segurança dentro das organizações. Paralelamente, na visão moderna, o erro humano é tratado como um sintoma de problemas mais profundos dentro do sistema. O erro humano está quase sempre vinculado às ferramentas utilizadas, às tarefas executadas e ao ambiente operacional.

A perspetiva antiga destaca o baixo rendimento dos trabalhadores envolvidos nas situações problemáticas e coloca em evidência os seus comportamentos erráticos, desadequados ou inapropriados. Destaca as más decisões, as más avaliações e os desvios aos procedimentos escritos, por parte dos trabalhadores. Esta visão assenta nos seguintes pressupostos: o trabalhador não prestou atenção suficiente à situação, pois se tivesse prestado atenção aos sinais, aos dados ou a determinada informação, nada teria acontecido; o trabalhador deveria ter-se esforçado mais; ou ainda, o trabalhador pensou que fazer um atalho de uma simples regra de segurança seria irrelevante. Deste modo, a maior parte dos erros parece que proveio de uma maçã podre (trabalhador incompetente, distraído ou inábil). Por isso, a questão subjacente para as organizações será a de saber como lidar com a falta de fiabilidade do fator humano, que a qualquer momento é suscetível de emergir?

Ainda segundo a perspetiva antiga do erro humano, uma das formas de construir a prevenção é elaborar mais regras e procedimentos mais apertados. Contudo, a conceção que preconiza o comportamento humano, em contexto real de trabalho, como algo que se pode limitar ao cumprimento estrito e permanente de determinadas normas, regras e procedimentos de segurança é bastante redutora. O desempenho humano é variável e não pode ser visto como algo imutável e invulnerável a alterações bio-psicossociológicas. Apenas num cenário paradisíaco e irrealista é reiterada a “fantasia ou ilusão” do ser humano ideal, ou seja, do trabalhador perfeito que não é suscetível de estar momentaneamente desatento, que nunca pode estar cansado e que trabalha sempre com o mesmo ritmo, que não adoece nem tem alterações de humor, que não tem problemas familiares ou conflitos com os colegas. Parece absurdo pensar que todas estas e outras condições não são capazes de influenciar o desvio ao cumprimento de normas, regras e procedimentos e, por consequência, produzir erros e/ou acidentes. Está totalmente ultrapassada a antiga comparação entre o funcionamento do sistema cognitivo humano e uma máquina, tal como foi proposto nos primórdios da ergonomia (Wisner, 2003).

A visão antiga do erro humano tende a não considerar algumas variabilidades inerentes ao próprio trabalhador, nem fatores, interações e influências resultantes do próprio processo de trabalho, tais como a sobrecarga de trabalho, a elevada exigência de algumas tarefas ou funções, a personalidade do trabalhador, a relação com colegas, a permanente interferência de técnicas, tecnologias ou fatores ambientais. Neste contexto, parece que os perigos e os riscos dos locais de trabalho são elementos neutros, com características insuscetíveis de influenciar o comportamento humano. Mas, na verdade, não são; todas elas podem exercer uma influência surpreendente na nossa forma de atuar. Para além de tudo isto, ainda há a ilusão de livre arbítrio (Reason, 1997), já mencionada anteriormente. Esta ilusão está assente no pressuposto de que as pessoas podem escolher entre cometer erros e não os cometer, independentemente do mundo à sua volta. Esta é também a ilusão de omnipotência. Mas, na realidade, as pessoas não são imunes às pressões do meio onde se encontram, nem as empresas que os empregam querem que o sejam. Errar ou não errar não é uma escolha: as pessoas trabalham com constrangimentos múltiplos, pressões e incertezas que determinam o seu desempenho.

A perspetiva moderna do erro humano preconiza que os sistemas não são intrinsecamente seguros. São as pessoas que trabalham nas organizações que têm de criar a segurança, através do conjunto disponível de tecnologias, adaptando-se às pressões existentes e agindo sob cenários de indeterminação ou ambiguidade. A segurança nunca é o único objetivo nos sistemas onde as pessoas operam. Existem sempre pressões e objetivos múltiplos, por vezes contraditórios. Existem imposições económicas, prazos, competição, entregas urgentes ao cliente, uma imagem pública que é necessário defender, etc. Para criar segurança, na visão moderna, são necessárias pessoas. São elas que podem ultrapassar os vários obstáculos inerentes ao trabalho real (Dejours, 2013; Sznelwar, 2015; Areosa, 2019), as vulnerabilidades e as formas incompletas de conhecimento do mundo atual do trabalho. Os erros não aparecem inesperadamente: são o lado obscuro da especialização humana e estão relacionados com a habilidade para conduzir as pressões, ambiguidades e resultados incertos.

A nova visão, preconizada por Dekker (2006), assenta num conjunto de evidências científicas que foram sendo construídas ao longo dos tempos, nomeadamente nos seguintes aspetos:

As fontes do erro são estruturais e não pessoais. Para compreender a origem dos erros humanos deve-se analisar o âmago sistémico onde as pessoas trabalham e deixar de procurar as imperfeições individuais;

Os erros e os acidentes apenas estão “remotamente” relacionados. Os acidentes emergem da complexidade e não da sua aparente simplicidade, isto é, não resultam apenas de erros humanos ou de uma violação dos procedimentos. Decorrem de múltiplos fatores, os quais interagem conjuntamente e conduzem esse mesmo sistema a ultrapassar o seu limiar de segurança;

Os acidentes não são o resultado de um erro humano isolado, imiscuído num processo que funcionaria na perfeição (sem o referido erro). Pelo contrário, a investigação de acidentes tem vindo a demostrar que os acidentes são subprodutos estruturais de um sistema em laboração normal.

Os erros e as falhas emergem da própria dinâmica do trabalho e da organização. São sintomas de problemas mais profundos, que resultam de fragilidades no funcionamento da organização. Isto também significa que as falhas resultam das decisões e da própria natureza do trabalho quotidiano. Os erros humanos estão longe de serem essencialmente casos isolados de indivíduos que se comportam de forma incorreta.

Esta nova perspetiva não está tanto centrada nos erros e violações dos trabalhadores, mas antes nos mecanismos e situações que podem gerar estes comportamentos, considerando os atuais contextos de trabalho dinâmicos (Rasmussen, 1997), nomeadamente as modificações nas estratégias organizacionais e/ou a variabilidade nas tarefas ou atividades. A visão moderna pretende perceber os motivos que levaram uma dada pessoa, num certo momento, a comportar-se de uma certa maneira, tendo em conta o ambiente operacional e organizacional que a envolvia. De facto, a posteriori, depois de o evento ter ocorrido, a maior parte dos erros parecem ser perfeitamente acauteláveis. Mas esta aparente simplicidade é normalmente enganosa. Sob cada história simples de erro existe uma outra história, mais profunda, mais complicada, uma história organizacional, uma história sobre o sistema em que a pessoa trabalha. É essa história que incorpora as falhas organizacionais em incubação, isto é, os “agentes patogénicos” que podem vir a provocar os desastres (Turner, 1978).

É pertinente voltar a sublinhar que a segurança nunca é o único objetivo dentro das empresas. A organização existe para fornecer serviços ou produtos e lucrar economicamente com essas atividades. Regra geral, os trabalhadores fazem o seu melhor para conciliar os diferentes objetivos propostos. Porém, no contexto de trabalho atual, verifica-se que estão a emergir novas formas de subalternidade, em que predomina a lógica do “colaborador colonizado” e do “gestor colonizador” (Mendes, 2018). A pressão da produção influencia as escolhas dos trabalhadores, fazendo normal ou aceitável o que era anteriormente irregular ou perigoso. Por vezes, os trabalhadores também podem estar focados em riscos anacrónicos. Para além disso, as novas ferramentas, técnicas ou tecnologia modificam as oportunidades para o erro e produzem novos caminhos para as falhas (por vezes difíceis de antecipar).

Não são raras as vezes em que a segurança dentro das organizações é prejudicada pelo feedback da gestão sobre o que é realmente importante (normalmente a produção). As técnicas de gestão colocam o mundo do trabalho sob enorme pressão (Gaulejac, 2007). Os sistemas não são automaticamente seguros; são as pessoas que têm de criar a segurança através das suas práticas em todos os níveis da organização. Os sistemas têm intrinsecamente contradições entre a eficiência operacional e a segurança. Mas, se olharmos para o erro humano como um sintoma de problemas organizacionais, então podemos assumir o compromisso de procurar a origem desse sintoma. O erro humano é, assim, um ponto de partida e não uma conclusão. Não é uma explicação para os problemas, mas carece de uma explicação focada no sistema dinâmico e eventualmente complexo da organização. Resumidamente, esta segunda perspetiva - indubitavelmente mais complexa e profunda - revela que são as pessoas que criam o sucesso e a segurança. Os trabalhadores dentro destes sistemas aprendem a gerir as múltiplas pressões, vulnerabilidades e contingências e, simultaneamente, desenvolvem estratégias para que estes riscos não se materializem. Infelizmente, nem sempre o conseguem.

Amalberti e a gestão cognitiva dinâmica

A quarta e última abordagem que pretendo mostrar foi concebida por Amalberti (1996). O autor aborda o tema do erro humano a partir de um modelo que pode ser designado por gestão cognitiva dinâmica. Os trabalhadores procuram quase sempre tornar o seu trabalho mais confortável, gratificante e com o mínimo de falhas (tanto quanto isso lhes for possível). A atividade humana depara-se com um mundo cada vez mais dinâmico, por isso essa mesma atividade caracteriza-se pela contínua adaptabilidade a novas situações e pela tentativa de ultrapassar o conflito entre pressões e objetivos/necessidades. A pressão (Gaulejac, 2007) e a intensificação do trabalho (Rosso, 2008) são cada vez maiores e com esse contexto os erros também parecem aumentar. Para além disso, a literatura que estabelece a relação entre fatores humanos e segurança demonstra que o universo laboral é sempre passível de gerar algumas “armadilhas cognitivas” aos trabalhadores, as quais são suscetíveis de originar erros (Amalberti, 1996), embora estas armadilhas possam existir em qualquer circunstância das nossas vidas (Kahneman e Tversky, 1979).

Trabalhar implica sempre algum esforço, ultrapassar obstáculos e vencer dificuldades (Dejours, 2013). É por isso que os trabalhadores efetuam permanentemente uma gestão cognitiva da sua atividade (Amalberti, 1996). Em certos casos, essa gestão utiliza alguns mecanismos para a redução do esforço mental (heurísticas, rotinas, experiência individual, etc.) para ajudar a simplificar as dificuldades que surgem durante a atividade. Isto significa que os trabalhadores pretendem evitar a utilização de recursos cognitivos “desnecessários” (pelo menos a partir do seu ponto de vista), efetuando alguns ajustes, os quais nem sempre são totalmente seguros, mas aparentemente são mais eficazes do ponto de vista cognitivo. A utilização de determinadas regras, normas ou procedimentos pode tornar a execução do trabalho mais lenta, fatigante ou exigente do ponto de vista do consumo de recursos cognitivos. Por isso, os trabalhadores tendem a recorrer a certas generalizações e automatismos (suscetíveis de não considerar algumas especificidades), cuja grande vantagem é conseguir fazer o trabalho fluir de forma mais facilitada. Esta ideia é designada como “custo cognitivo útil” (Amalberti, 2016, p. 60). Esta estratégia consegue garantir a segurança das organizações na maior parte do tempo. Porém, o lado contraproducente da gestão cognitiva dinâmica é poder dar origem a alguns tipos de erros e, por consequência, a eventuais acidentes (embora Amalberti apresente argumentos que contrariam a racionalidade desta aparente “boa ideia”, nomeadamente no que toca à relação entre erros e acidentes). Adiante irei voltar a esta questão.

René Amalberti (2016) refere que os seres humanos não pretendem, essencialmente, trabalhar sem erros; pretendem, acima de tudo, obter resultados satisfatórios, minimizando os custos negativos do trabalho (cansaço, acidentes, tempo perdido, etc.). O foco principal é atingir as metas pré-estabelecidas, mantendo o controlo cognitivo da situação. Do ponto de vista teórico, as pessoas deveriam conseguir gerir a sua atividade através da aplicação rigorosa de regras, normas e procedimentos. Na prática isso não acontece, visto que os trabalhadores necessitam quase sempre de equilibrar os seus recursos e as exigências do trabalho, efetuando um constante ajustamento entre aquilo que precisa de ser feito e o modo de alcançar determinados objetivos. Esta questão remete-nos, por exemplo, para a descoincidência entre o trabalho prescrito e o trabalho real (já anteriormente mencionada), além dos modos de funcionamento cognitivo dos trabalhadores. A mente humana tem um plafond limitado de recursos para processar a informação necessária ao desenvolvimento das suas atividades. Os processos que exigem maior concentração e atenção consomem mais recursos do que os processos conhecidos e rotineiros; estes últimos tendem a não comprometer as nossas reservas mentais. Em psicologia cognitiva, estes processos mentais para atividades de rotina são designados esquemas ou scripts. Eles são normalmente muito úteis; todavia, em certos casos podem originar dois tipos distintos de erros: por ativação inadequada dos esquemas ou por execução deficiente dos esquemas. Para além disso, ainda existem diferenças entre trabalhadores. Regra geral, os especialistas utilizam melhor as rotinas do que os principiantes e sabem gerir de forma mais assertiva a sua “maquinaria cognitiva”, logo, estão normalmente mais aptos para saber controlar situações de sobrecarga de trabalho (Amalberti, 2016).

Em contexto laboral Amalberti (1996) destaca a questão de que as estratégias cognitivas adotadas pelos trabalhadores só fazerem sentido quando compreendidas e analisadas a partir das suas perspetivas concretas e singulares, isto é, considerando plenamente as especificidades e idiossincrasias das pessoas que as empregam. A gestão da prevenção dentro das organizações teria ganhos efetivos de segurança se compreendesse melhor a mente do trabalhador e verificasse que a gestão de riscos individuais se baseia em saberes extremamente sofisticados de ajustes e de controlo global das situações. Por oposição, uma visão ingénua da cognição “ideal” esperaria do trabalhador um ganho de segurança e uma redução dos erros, se conseguíssemos fazê-lo seguir à risca os procedimentos recomendados, sem desvios (Amalberti, 2016). Essa expectativa é, em grande parte, ingénua; seguir à risca as regras e procedimentos é algo similar à “greve de zelo”, também designada como operação padrão ou operação tartaruga (Dejours, 1999). O problema é que quando isto acontece as organizações correm o sério risco de se tornarem disfuncionais.

Hoje em dia estamos a criar alguns sistemas ultra-complexos (Perrow, 1999), os quais estão a melhorar as nossas condições de vida (este é o lado positivo da questão); porém, estes sistemas estão a elevar os nossos riscos sociais e tecnológicos, potenciando a ocorrência de erros, muitos deles detetados tardiamente (este é o seu lado negativo). A nossa capacidade de produzir sistemas sociotécnicos complexos excede a nossa capacidade de compreendê--los. Isto transforma-se no grande dilema dos sistemas de segurança nas organizações complexas de alto risco (Areosa, 2012); talvez, inadvertidamente, nós estejamos a criar a complexidade de amanhã, tentando resolver os problemas de hoje com a mentalidade de ontem. Afinal a mente humana não evolui ao mesmo ritmo que as nossas tecnologias; é por isso que se pode afirmar, ironicamente, que a mente humana é da idade da pedra e nós somos homens das cavernas, apesar de vivermos num mundo repleto de tecnologia sofisticada (Gardner, 2008). Continuamos a produzir erros e a insistir nesses mesmos erros, porque - entre muitos outros aspetos - a nossa mente foi programada durante milhões de anos para atuar num ambiente totalmente diferente do atual. É pertinente lembrar que a nossa história evolucionária não nos preparou para gerir tanta complexidade e incerteza.

De certo modo, os erros humanos são a outra face da especialização humana; são também um subproduto do “trabalho normal” (sem erros). Os erros são, na maioria das vezes, uma consequência das situações em que se encontravam os indivíduos que os cometeram. Um erro é, regra geral, o resultado de uma situação em que um trabalhador ou uma equipa de trabalho não puderam utilizar as suas competências, normalmente por motivos relacionados com a conceção dos sistemas, os seus interfaces, a formação, os diversos imprevistos, etc. Por vezes, também nos esquecemos que cometer erros (particularmente os de rotinas) é a contrapartida para se conseguir trabalhar mais rápido e com maior eficácia social e económica. Aspirar ao controlo de todos os erros seria muitíssimo cansativo e iria traduzir-se num balanço negativo para os resultados do trabalho, cuja consequência expectável seria gerar uma enorme lentidão na execução das atividades. Por outras palavras, o atual padrão de trabalho e de produção seriam postos em causa.

Obviamente que há situações em que o erro humano pode servir de “gatilho” ou elemento desencadeador do acidente, mas os acidentes ocorrem normalmente porque existem perigos e riscos a montante que não estavam devidamente identificados e/ou controlados pela organização. Por isso, em si mesmo, o erro humano nunca carrega sozinho o risco do acidente (Amalberti, 2016), tendo em conta que os acidentes são eventos multicausais (Areosa, 2020). É importante lembrar o resultado de vários estudos, os quais demonstram que a maioria dos erros não traz consequências. Por exemplo, num avião comercial, a observação de 44 horas de voo sucessivas permitiu inventariar 162 erros, dos quais 157 foram recuperados pela tripulação. Somente um erro deu lugar a uma sinalização (Daniellou et al., 2010). Na perspetiva de Amalberti, o volume de erros não é um bom preditor do desempenho, é a recuperação dos erros que melhor prevê o desempenho do trabalhador. Para além disso, os erros cometidos parecem servir para o trabalhador se consciencializar da atividade, autoavaliar o seu funcionamento cognitivo, e definir o seu nível de aceitabilidade para correr riscos (Amalberti, 2016).

Para concluir, é relevante apresentar quatro grandes constatações acerca desta quarta perspetiva: “(i) os erros são mais frequentes do que se imagina, ocorrendo muitos por hora; (ii) são, porém, amplamente autodetetados e recuperados, de maneira que as consequências observadas são bem inferiores ao que faria prever a frequência do erro; (iii) eles são inerentes ao funcionamento cognitivo, especialmente o rotineiro, e não podem, portanto, ser suprimidos, exceto quando se suprime o homem; (iv) a simplificação excessiva - e errónea - da ligação entre erro e segurança não tem, de fato, resolvido as questões de segurança” (Amalberti, 2016, p. 44).

Considerações finais

Sabemos que a ideia de “erro humano” está amplamente disseminada como sendo um problema grave para as organizações. Muitos dos acidentes ocorridos em contexto laboral continuam ainda a ser atribuídos a fatores humanos ou causas pessoais, tais como: ignorância, descuido, desleixo, negligência, distração, julgamentos inadequados, incumprimento de normas, procedimentos ou regras, distúrbios psíquicos, etc. Por exemplo, a teoria de dominó (Heinrich et al., 1980) anuncia que 88% das causas dos acidentes se devem a atos inseguros. Porém, esta apreciação monocausal é muito superficial e restritiva sobre a enorme variedade de causas que podem estar na génese dos acidentes (nomeadamente aspetos estratégicos, gestionários, organizacionais, tecnológicos, etc.), ou seja, não considera todas as circunstâncias e condicionantes, enquanto conjugação múltipla de fatores. As quatro perspetivas preconizam que devem ser as organizações a promover a prevenção, definindo medidas e tomando certas precauções para evitar os acidentes. A culpabilização estrita dos erros humanos, particularmente dos trabalhadores operacionais, já demonstrou não ter capacidade para resolver os problemas de segurança dentro das organizações. Responsabilizar as pessoas pelos seus erros (maioritariamente potenciados pelas condições organizacionais) e puni-las apenas salva a face das empresas. Isso gera a ilusão de que o problema era apenas individual. Contudo, este tipo de práticas dá origem a um outro erro: acreditar que o problema ficou resolvido. É verdade que ao nível do senso comum existe uma certa tendência para não dissociar o erro humano da culpa. Mas as quatro perspetivas que acabei de abordar trazem uma nova visão para a relação entre o erro humano e os acidentes, nomeadamente por afastarem a ideia de que os erros humanos são a única, ou a principal causa, para esses eventos. Na atualidade, é consensual que os acidentes são heterodeterminados, dependem da articulação de várias causas (Areosa e Dwyer, 2010) e que vão muito para além dos erros humanos. Aliás, em contexto organizacional, o erro humano pode resultar de uma conceção excessivamente regulamentar e normativa do trabalho, assente no cumprimento rigoroso dos procedimentos, que, por vezes, ignora as dificuldades, especificidades e restrições impostas aos trabalhadores; no entanto, são essas condições que podem fazer emergir com maior facilidade a ocorrência de erros (Llory e Montmayeul, 2014). Em parte, o erro humano é um rótulo para uma causa presumida (Woods et al., 2010). Em termos teóricos, quase todos os erros poderiam ter sido evitados; todavia, do ponto de vista prático ou empírico não é possível evitar e/ou prevenir todos os erros. Isto significa que uma sociedade isenta de erros é utópica e irrealista, embora esta ideia possa ser útil num sentido teleológico.

Os erros no trabalho podem ser potenciados por certas habilidades que se tornaram automatismos. Os hábitos de comportamento (a partir das rotinizações) são normalmente eficazes e permitem aos trabalhadores desenvolver a sua atividade de forma mais rápida e com menos esforço (minimizando os custos cognitivos do trabalho). Mas como estes mecanismos são colocados em prática de forma subconsciente, basta alguma mudança no contexto em que são aplicados para se poderem transformar em erros. Este é o seu lado contraproducente. O erro humano é um fenómeno extremamente comum. As pessoas, independentemente do nível de habilidade e experiência cometem vários erros todos os dias. Fechar a porta de casa deixando a chave dentro do apartamento, escolher a saída errada na rotunda enquanto conduz o automóvel ou esquecer de colocar uma carta no correio são todos exemplos dos erros plausíveis que as pessoas podem cometer no quotidiano. Porém, é pertinente lembrar que cada erro tem a singularidade do seu contexto. É interessante verificar que não basta simplesmente perguntar aos trabalhadores quais são as suas dificuldades nas tarefas rotineiras, porque grande parte dos problemas já se tornaram “naturais” e tendencialmente deixaram de ser percebidos como problemáticos.

A típica consequência de quando se cometem erros é falhar na obtenção do resultado desejado ou produzir um resultado indesejável. A maioria dos erros diários que as pessoas cometem tem um impacto reduzido, que pode ser rapidamente recuperado. No entanto, quando os mesmos tipos de erros são cometidos em sistemas sociotécnicos complexos, as consequências podem ser muito piores. Foi por isso que o presidente da comissão de investigação do acidente TMI “desesperou” para tentar encontrar quem tinha deixado umas válvulas de refrigeração na posição errada e quase provocou a fusão da central nuclear (Perrow, 1999). Mas em organizações com estas características, imiscuídas nas atuais sociedades dinâmicas, há sempre a possibilidade de ocorrer uma migração em direção à falha, devido, por exemplo, às múltiplas pressões de produção (Rasmussen, 1997). Num outro contexto, Robert Helmreich (1994) estudou a fundo o desastre do voo 52 Avianca e defendeu que os fatores culturais estariam profundamente imiscuídos na explicação dos comportamentos aparentemente erráticos dos pilotos (é pertinente lembrar que este acidente aconteceu devido ao avião ter ficado sem combustível e todos os membros do cockpit sabiam disso).

Reason (1990) defende que os erros dos trabalhadores (inevitáveis e inerentes à própria condição humana) não são a principal causa dos acidentes. De facto, nos dias de hoje, os atos inseguros ou erros humanos já não devem ser vistos como a causa principal do acidente, mas antes como uma entre muitas causas. Aliás, segundo Reason (1997, p. 10), os erros humanos devem cada vez mais ser vistos como consequências das organizações e cada vez menos como causas principais dos acidentes. A investigação dos acidentes organizacionais não se pode limitar à responsabilização dos trabalhadores pelos seus erros, falhas ou violações, pelo contrário, o esforço na procura das falhas ativas deve antes ser canalizado para a deteção e respetiva correção das condições latentes existentes nas organizações. Ainda na ótica de Reason (1997) será quase sempre mais favorável assentar a prevenção das organizações em fatores não--humanos ou, no mínimo, criar redundâncias na prevenção com contributos humanos e não-humanos. Regra geral, a corrida por mais procedimentos para obter menos incidentes e acidentes pode produzir os germes de uma menor adaptabilidade dos trabalhadores, fazendo perder uma parte da sua utilidade para a gestão dos riscos. Uma gestão mais assertiva da prevenção deve assentar na procura de vulnerabilidades organizacionais. O estado da segurança é sempre dinâmico e não está apenas em pessoas isoladas, equipamentos ou departamentos de uma qualquer organização. O futuro da prevenção deve privilegiar a procura de vulnerabilidades sistémicas e não tanto falhas individuais. E nunca podemos interpretar o sucesso passado como sinónimo de segurança para o futuro (Amalberti, 2016).

Para Hollnagel (2009), os progressos da segurança passam mais pelo estudo e pela otimização das capacidades humanas naturais, as quais têm demonstrado um ótimo nível de segurança na esmagadora maioria das situações, do que pelo estudo dos erros e das falhas. Devido à excessiva focagem nas falhas foi sendo construída uma persistente ligação erro-acidente. Os dois termos surgem quase sempre entrelaçados e, por isso, abominamos qualquer erro. Para além disso, é minimizado o papel estruturante do erro na resolução de problemas (Amalberti, 2016). É por este motivo que corroboro a opinião de diversos autores (Perrow, 1999; Vaughan, 1999; Almeida, 2003; Granjo, 2004; Hollnagel, 2004; Woods et al., 2010; Daniellou et al., 2010; Llory e Montmayeul, 2014) que defendem ser redutor atribuir a principal causa dos acidentes ao erro humano. Um dos acérrimos defensores desta perspetiva pode ser encontrado no prefácio da obra de Llory (1999), redigido por Gérard Mendel, onde é afirmado que continuar a atribuir a culpa dos acidentes aos trabalhadores hierarquicamente inferiores pode ser interpretado como uma “cegueira maciça” que tem como princípio subjacente tentar poupar as hierarquias de topo. Contudo, Amalberti (1996) refere que muitos acidentes são evitados graças aos trabalhadores que atuam nas empresas. Os trabalhadores são o garante da segurança nas organizações (e não o contrário). Atualmente, o estudo do designado erro humano e o seu contributo para os acidentes está longe de ser um tema epistemologicamente encerrado.

Em resumo, os diversos mecanismos que estão por detrás do desempenho humano ainda não são completamente conhecidos, particularmente as questões de natureza cognitiva. Em determinadas situações, estes processos podem não ser algo que decorra de ações ou omissões conscientes. Mesmo em processos conscientes, o recurso a determinados erros por parte dos trabalhadores pode tornar-se “aceitável” do ponto de vista cognitivo. Incorporar estes aspetos da condição humana na gestão da segurança das organizações é um dos grandes desafios da contemporaneidade. As quatro perspetivas abordadas no texto vão precisamente nessa direção, tendo oferecido uma nova conceção sobre a relação entre o erro humano e os acidentes. Os autores defendem que dificilmente os erros humanos estão sós na relação com os acidentes. A incumbência de criar estratégias para detetar, corrigir e recuperar os erros humanos ocorridos no universo laboral compete, sobretudo, às organizações. A segurança das organizações não pode assentar exclusivamente na suposta fiabilidade humana. Quando isso acontece, o sistema de segurança torna-se mais frágil e, por consequência, mais vulnerável a acidentes.