Introducción

En los últimos años, el debate alrededor de las fake news, la desinformación y los contenidos desinformativos, han cobrado cada vez mayor peso, tanto a nivel académico como periodístico (Alfonso, Galera y Calvo, 2019). El escenario digital actual se ha convertido en un espacio especialmente importante, al momento de captar e influir en la opinión pública dispuesta en nuestras sociedades (Campos-Domínguez y Calvo, 2017). Se presentan entornos cada vez más caracterizados por un ecosistema comunicativo híbrido, en el que conviven medios tradicionales y digitales, al momento de llevar a cabo acciones de difusión por parte de actores políticos o sociales (López-García, 2016). Lo antes expuesto estaría favoreciendo la promoción de una cultura de la desinformación, en la que se promueve contenido falso creado intencionalmente para condicional o manipular la opinión pública, alrededor de un determinado tema o grupo social (Wardle y Derakshan, 2017).

El escenario digital actual se ha convertido en un espacio para captar e influir en la opinión pública (Campo Domínguez y Calvo, 2017). Las redes sociales se han convertido en nuevos contenedores de acceso inmediato a contenidos por parte de ciudadanos-usuarios (Casero-Ripollés, Feenstra y Tormey, 2016), los cuales crean un ambiente propicio para que estos se conviertan en ecos de resonancia de contenidos, muchas veces sin verificar (Van der Linden et al., 2017; Rodríguez Fernández, 2021). Este entorno favorece el avance y la transmisión de información falsa y contenidos desinformativos, destinados a favorecer la polarización de la opinión pública (Søe, 2018; Hrcková, et al., 2019; Levi, 2019).

Tanto en Twitter como en otras redes sociales (ej.: Facebook, Instagram o Tik Tok), la propagación de contenidos desinformativos se suele realizar de forma viral de diferentes formas (Kucharski, 2016), las cuales comienzan en distintas fases ya establecidas: la distribución, la amplificación y, por último, la inundación de espacios digitales como las redes sociales (Zhao et al., 2020). Una acción que estaría llevándose a cabo por micro y nano-influencers (por debajo de 100.000 y 10.000 seguidores respectivamente) (Wissman, 2018), y la capacidad de influencia que estos pueden generar, a causa de la mayor afinidad y fidelidad que tienen con sus seguidores, desde los temas que suelen ser tratados por estos (mayormente temas políticos y cultura-pop), abordados de forma humorística, emocional y vocabulario vulgar (Ong, Tapsell y Curato, 2019).

La estrategia empleada por los micro y nano-influencers se lleva a cabo desde lo que se ha dado en llamar como astroturfing, es decir, desde una acción comunicativa digital centrada en la espontaneidad y la libertad de expresión, hecha de forma organizadas y coordinada (Lits, 2020). Una estrategia destinada, principalmente, en la promoción de contenidos y temas, empleado en política, relaciones públicas y publicidad desde hace décadas (Sorensen, Andrews y Drennan, 2017), y que, con el auge de los escenarios digitales actuales ha cobrado un creciente uso e interés para la divulgación de contenido desinformativo (Elmas et al., 2019).

Bajo esta estrategia de difusión de contenidos desinformativos (astroturfing), los usuarios que lideran (alfa) no siguen la cuenta del cliente (influencers) para evitar ser detectados estos últimos, además de contar con un equipo de usuarios (no necesariamente bots, denominados beta) - quienes actúan de forma itinerante y con varias cuentas en redes sociales (en nuestro caso Twitter) asociadas a la vez -, encargados de: (1) contestar las diferentes interacciones generadas por los mensajes difundidos en este tipo de escenarios digitales; y (2) pasar el contenido desinformativo transmitido por los usuarios líderes (alfa) a usuarios influencers (ej.: periodistas y medios), con el propósito de generar tendencia (trending topics). Labores que sirven al monitoreo de la tasa de efectividad de la campaña de promoción de contenidos y temas de interés puesta en marcha por ambos perfiles de usuarios (alfas y betas), y que se hace a través de los diferentes small worlds o ultra-small-world, representados, el primero, por una alta densidad de pequeños grupos a los que los usuarios en las redes sociales suelen participar y que pueden tener una fuerte interconexión entre sí (Milgram, 1967; Himelboim et al., 2017); mientras que el segundo, se representa por una distancia más corta que lo observado en los small worlds, entre nodos que integran la red elaborada y promovida, a través de los mensajes publicados por determinados usuarios (Barabási, 2016; Menczer, Fortunato y Davis, 2020).

Aunque el astroturfing se ha usado desde hace décadas y su origen se enmarca en el período de la Segunda Guerra Mundial, el auge de los escenarios digitales de comunicación ha contribuido a su empleo y efectividad, desde seguidores asociados a cuentas creadas para compartir y reafirmar las creencias y las formas de pensamiento e ideología (Niño González, Barquero Cabrero y García García, 2017; Kovic et al., 2018).

Los mensajes creados y enmarcados en el astroturfing parten inicialmente desde contenidos dirigidos a un número determinado de usuarios, durante un marco de tiempo reducido. Algo que, posteriormente, es reforzado por mensajes compartidos por cuentas, controladas por humanos o por bots automatizados, encargados de detectar y monitorear el éxito o no de la campaña en las redes (Keller et al., 2019).

Existen organizaciones o grupos interesados en alcanzar la manipulación de la opinión pública desde las redes sociales, desde el uso activo de granjas de trolls o farm trolls, que tienen como objetivo la concreción del propósito expuesto en el párrafo anterior (Bradshaw y Howard, 2017). Ello, desde la diseminación intencional de información sarcástica y/o falsa, destinadas a promover las condiciones socio-comunicativas que favorecen la alteración del sentido de credibilidad colectiva online (Del Vicario et al., 2016), pero, sobre todo, intentar ocultar el interés en incidir en la opinión pública, mediante vectores neutros de discurso y otros métodos (Pérez Colomé, 2020). Algo, identificado por autores como Bastos y Marcea (2018), Golovchenko et al. (2020) o Santana y Huerta Cánepa (2019), durante el Brexit en el Reino Unido (2016), las elecciones de los Estados Unidos (2016), o las elecciones en Chile en (2017).

La existencia de empresas centradas en crear campañas de desinformación (basadas en el astroturfing), desde el uso masivo de trolls procedente de Filipinas o Macedonia del Norte, a través de redes sociales (ej.: Facebook, Instagram o Twitter), ha sido analizado por autores como Ong y Cabañes (2019) o Collins y Zadrozni (2020). Acciones que se llevan a cabo desde países sin regulación legislativa, ni políticas que luchen contra los contenidos desinformativos, y cuya experiencia e infraestructura podrían ser exportados hacia otros países, desviar la atención en debates políticos, desde la sobreexposición de temas directamente o no relacionados con estos (Mahtani y Cabato, 2019; Bengali y Halper, 2019).

Método

Este trabajo tiene como objetivos estimar hasta qué punto se está haciendo uso del astroturfing, como estrategia para la promoción de debates políticos en España, a través de Twitter. Además de identificar desde dónde se distribuyen, amplifican e inundan los espacios digitales con contenidos asociados a hechos o actores políticos en dicho país.

El abordaje del objetivo planteado en este trabajo se llevará a cabo desde el estudio de caso asociado al debate generado alrededor las vacaciones llevadas a cabo por el vicepresidente segundo del Gobierno de España, Pablo Iglesias, junto con su pareja, la ministra de Igualdad Irene Montero, durante el mes de agosto de 2020, en el Principado de Asturias, al norte de España. Un debate que trascendió la opinión pública en España, al generarse ataques desde las redes sociales (Sánchez, 2020), alrededor de la etiqueta #LaFascistaDeLaSole y mensajes asociados con palabras como “Iglesias AND Asturias”, directamente relacionados con dos momentos claves dentro del debate abordado como caso de estudio en este trabajo:

Durante la identificación y arribo de los ministros españoles al Principado de Asturias (España).

Cuando se ataca a la supuesta persona que ubicó e hizo público el lugar donde se encontraban estos ministros.

El trabajo parte de un enfoque cuantitativo de investigación, que toma como unidad de análisis la totalidad de los mensajes emitidos y capturados en Twitter, a través del software libre para estadística R bajo entorno RStudio (versión 1.2.5033) y aplicando la librería RTweet (Kearney, 2019).

La selección final de la muestra está integrada por 89.528 tuits publicados en lengua española por 42.584 usuarios, emitidos entre el 14 y el 20 de agosto de 2020 y que siguen la siguiente distribución de la muestra:

74.826 tuits publicados por 35.327 usuarios de Twitter, asociados a mensajes que cumplan el filtro que contengan las palabras “Iglesias AND Asturias”.

14.702 tuits por parte de 7257 usuarios de Twitter, asociados a la etiqueta hashtag #LaFascistadelaSole.

Una muestra que fue ordenada, de acuerdo con la geolocalización de los mensajes, mediante coordenadas de latitud, longitud y el radio de influencia. Una tarea que tomó en consideración el listado de países identificados como emisores de mensajes de desinformación en redes sociales, por autores como Bradshaw, Bailey y Howard (2021) y Collins y Zadrozni (2020).

La búsqueda geolocalizada de los países en que fueron emitidos los mensajes que integran la muestra tomada para el abordaje del tema considerado como caso de estudio aplicó la técnica de análisis geolocalizado de los tuits, empleada por autores como Holbrook et al. (2016), a través del uso de la API Mapbox geocoding.1 Pese a no lograrse una fiabilidad del 100%, en la identificación de los países emisores de los mensajes analizados, se cumple con los niveles de fiabilidad global media aplicado en otros estudios (Van der Veen et al., 2015), de 77,8%; alcanzando niveles superiores al antes expuesto, en países como Estados Unidos y Reino Unido (90%), España (85,8%) o Filipinas (83,9%).

Los resultados mostrados en este trabajo parten del análisis de redes (Hu, 2006; Blondel et al., 2008; Barabási, 2016), hecho a través de Gephi (versión 0.9.2). Lo que nos ayudará a observar las estructuras y relaciones entre las cuentas vinculadas a los tuits capturados, en los términos expuestos por Bastian, Heymann y Jacomy (2009).

La probabilidad de comportamiento bot de los usuarios asociados a los mensajes que integran la muestra estudiada, se hizo a través del uso de la librería experimental en R Tweetbotornot (Kearney, 2018), la cual tiene en consideración el historial de cada cuenta analizada, así como los mensajes emitidos a lo largo del tiempo y la naturaleza de sus perfiles. Este análisis logró alcanzar una media de acierto del 91,9%.

Se realiza, por último, un estudio de valencia o polarización positiva-negativa del discurso, así como de las emociones básicas mostradas en los mensajes. De esta forma se pretende determinar la percepción de un grupo de opinión ante unos hechos específicos (Fernández Vallejo, 2018). Para establecer tanto el sentido, positivo o negativo, y su intensidad, en esta investigación se atribuyó a través del léxico desarrollado por el National Research Council of Canada (NRC), versión 0.9.2 en su versión en castellano (Mohammad y Turney, 2012). Mediante la comparación de cada frase frente al léxico, centrado en nombres, adverbios y adjetivos, se le asigna un valor positivo o negativo de +1 o -1, que se ve amplificado o disminuido por adjetivos o adverbios, obteniendo un global del mensaje (Swati, Pranali y Pragati, 2015) y obtener una orientación semántica del conjunto (Taboada et al., 2011). Aprovechando el mismo léxico, que presenta atribuciones de las emociones básicas planteadas por Plutchik (1980): asco, alegría, tristeza, enfado, confianza, ira, anticipación y sorpresa, se atribuyeron valores para determinar su presencia en cada mensaje. Dichos estudios sobre las emociones fueron desarrollados posteriormente en la teoría de las inteligencias múltiples (Sautera et al., 2010). Todo este proceso se realizó mediante la librería Syuzhet en R, mediante técnicas de machine learning sobre grandes volúmenes de texto, con la limitación de que aunque está muy consolidado en lengua inglesa, presenta una eficacia menor, en torno al 70%, en lenguas latinas (Mohammad, 2016). Los gráficos fueron representados en R mediante la librería Ggplot2 en R.

Resultados

A pesar de que las primeras noticias, alrededor del tema estudiado, salieron en los principales medios de comunicación de prensa local de Asturias en España, el 15 y 16 de agosto de 2020 en la tarde (a partir de las 14 horas), el debate en Twitter se puede encontrar, con anterioridad en el tiempo, algunos tuits, publicados por cuentas asociadas a contenidos ideológicos de tendencia ultraderecha (con abundantes banderas de España en su perfil, así como uso de emblemas y colores verdes usados por el partido Vox).2 En los mismos se da cuenta de la presencia del vicepresidente primero Pablo Iglesias, y la ministra de Igualdad del gobierno de España, Irene Montero, en el pequeño pueblo de Felgueras (Asturias, España) (ver figura 1).

Nota: Tuits recabados el 14 de agosto de 2020 (a las 08:37), y el 15 de agosto de 2020, por los autores

Figura 1 Primeros tuits localizados que hablan del tema analizado

A la derecha de la figura 1 se sitúa el tuit que es identificado, como el mensaje que realiza una ubicación exacta de la ubicación, emitido el 15 de agosto de 2020 a las 19:02 horas, por parte de la cuenta @_soledad_R.3 Este mensaje dará lugar a la etiqueta #LaFascistadelaSole, aparecida por primera vez el 17 de agosto a las 20:39 (horario peninsular español) (ID: 1295430014557663232) junto a la llamada o nombramiento de otras diez cuentas.

Primer momento de debate alrededor de los ministros

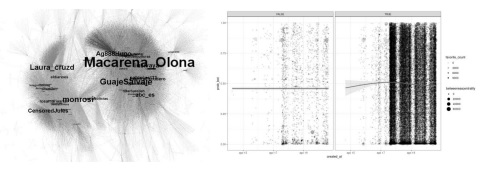

La figura 2, nos permite ver el análisis de clúster de los mensajes asociados con a mensajes con palabras como “Iglesias AND Asturias” (74.826 tuits publicados por 35.327 usuarios de Twitter), compuesto por 142 comunidades de usuarios distintas, con un valor de modularidad de 0,549. Entre dichas agrupaciones se pueden observar dos grandes conjuntos muy interrelacionados entre si internamente pero poco a nivel externo, siguiendo la formación de filtros burbuja destacada por Pariser (2011). A la izquierda de la figura 2, muestran los usuarios que apoyan a los ministros (con un tráfico del 36,8% del total de tuits); mientras que a la derecha se encuentran los grupos de usuarios (más numerosos), que critican a los ministros (con un tráfico del 45,4% del total de tuits). En general, el bloque a favor de los ministros mueve menos de un 40% de los tuits, mientras que los críticos movilizan más del 60% de los mensajes analizados.

Fuente. Elaborado por los autores

Figura 2 Grafo de tuits y representación en función del tiempo de ser bots alrededor de los mensajes com palabras como “Iglesias AND Asturias

Alrededor de los mensajes asociados a mensajes con palabras como “Iglesias AND Asturias”, se aprecian reenvíos de mensajes emitidos por medios de comunicación y columnistas, empleados como fuentes conocidas entre los usuarios que se muestran a favor o en contra del debate considerado para el desarrollo del caso de estudio aquí expuesto. De esta forma, se detectan reenvíos de mensajes entre los favorables a los ministros de @eldiario.es, @JesusCintora, @rosamariaartal o @sextanoticias; mientras que, entre los que se mostraron críticos con estos, destacan los reenvíos de los diarios @abc_es y @okdiario. Además, se observa cómo, entre los que atacan a los ministros, hay un seguimiento mayor de usuarios desconocidos, con un rol de influenciadores del debate muy activo, en comparación con quienes mostraron una posición favorable a estos. Únicamente se encuentra como usuario conocido la cuenta de la diputada de Vox @Macarena_Olona.

La figura 2, también revela que los mensajes se concentran en determinados momentos. Al representar la probabilidad de comportamiento bot, frente al tiempo entre tuits directos y RT, los tuits primeros aparecen principalmente tras el mediodía del día 15 de agosto de 2020. Dos días después, (en el mediodía del 17 de agosto de 2020), se observa una fase de inundación de mensajes en Twitter en el que, inicialmente, los mensajes publicados apenas son marcados como favoritos, y no tienen casi o nula relación de agrupación social (valores de intermediación de valor cero o muy pequeño). Por lo que, estos mensajes fueron lanzados desde numerosas cuentas, sin conexión entre sí, sin una gran cantidad de seguidores y sin relación aparente de interés alrededor del tema.

A pesar de que pueden encontrarse en mensajes directos, numerosas cuentas con alta probabilidad de comportamiento bot (figura 3), la media global de todas estas se mantiene por debajo del 50% y no varía a lo largo del tiempo. En el caso de los RT, en cambio, puede apreciarse un aumento de la media de probabilidad de ser bot, por encima del 50%, con la llegada de la fase inundación, del 17 de agosto de 2020, y se reduce considerablemente a partir del 19 de agosto de 2020, después de haberse logrado la viralización alrededor del tema analizado.

El estudio de intermediación (tamaño del punto en la figura) de la figura 3, refleja que existen cuentas que relacionan y vertebran la red entre sí que, aunque son escasas, una gran parte de estas presentan una alta probabilidad de ser bot (incluso por encima del 80%), tantos en mensajes directos como RT. Por tanto, las cuentas que conforman la red, alrededor de los mensajes, asociados con palabras como “Iglesias AND Asturias”, son principalmente sospechosas de comportamiento bot.

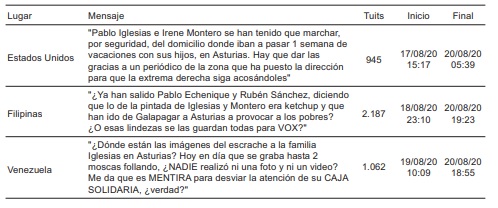

El análisis de geolocalización nos muestra diferentes ubicaciones desde donde fueron publicados los 74.826 tuits analizados. Pese a que el 30% de estos tuits no lograron identificarse el país de procedencia, 26.305 tuits fueron publicados desde España (de los cuales 19.389 proceden de Madrid, 480 de Asturias, 932 de Valencia, 477 desde Málaga-Almería o 306 desde Sevilla), y el resto en países como Filipinas (8.911 tuits), Estados Unidos (2.360 tuits), o Venezuela (1.544 tuits), por ejemplo (ver tabla 1). Este patrón de comportamiento geolocalizado que se va dando por tramos horarios a lo largo de los días analizados, en los que se van alternando distintos lugares de emisión muy concretos con mensajes publicados desde otros puntos, centrados en ayudar a promover la confrontación y polarización, bajo el intercalado de mensajes en ambos sentidos, a favor y en contra (ver tabla 1).

Segundo momento de debate alrededor de los ministros

Los tuits unidos a la etiqueta #LaFascistadelaSole, así como las llamadas a otras cuentas se va reproduciendo, durante las primeras horas de viralización junto a dos mensajes: “#LaFascistaDeLaSole No le cuentes un secreto. Lo divulga todo https://t.co/0DrSQdC0T7" (ID: 1295432145633239042), y ”#lafascistadelaSole quiere que todos los de UP pasen por su casa a saludarla, si sabéis su dirección, haced el favor de mandarla... https://t.co/sqOdQY0fKB" (ID: 1295434536554303490).

En el grafo mostrado en la figura 3 se expresan los retuits (RT) agrupados por clúster, alrededor de la etiqueta #LaFascistaDeLaSole, con un total de 6.897 nodos o usuarios y 12.687 enlaces. Se presenta un grado de modularidad de 0,573, en el que se observan dos grupos de mensajes (a la derecha), emitidos el 18 y 19 de agosto de 2020: Uno de los clústeres, genera el 20,17% del tráfico de tuits, mientras que el otro genera el 18,81%. Estos grupos se centran en protestar por la polarización de la red, y atribuyendo el origen de que quien sacó a la luz el lugar de vacaciones de los ministros, a la cuenta de la agrupación de Podemos de la localidad de Lena (ID: 1295660335706386432). A la izquierda de la figura 3 se encuentran grupos de usuarios desagregados en diferentes agrupaciones, pero muy próximos y conectados entre sí, concentrando el 71% del tráfico de tuits alrededor de la etiqueta analizada. En ambos grupos, no se encuentran cuentas oficiales o de personajes conocidos entre los distribuidores, a excepción de la politóloga rusa @liusivaya que en 2020 atacaba mucho al gobierno Socialista-Podemos, recibiendo apoyos públicos por parte de dirigentes del partido Vox, y que en 2022 defiende las posturas del gobierno ruso de Vladimir Putin en medios españoles y redes por la guerra de Ucrania (Marrón, 2022).

Fuente: Elaborado por los autores a través de Gephi y R.

Figura 3 Grafo de tuits y representación en función del tiempo de ser bots alrededor de la etiqueta #LaFascistadelaSole

En el análisis de probabilidad bot de las cuentas asociadas a la etiqueta #LaFascistadelaSole (figura 3), se observa una distribución inicial, amplificación e inundación posterior. Igualmente se aprecia una probabilidad bot del 50%, tanto en cuentas que escriben contenido directo como en retuits. También, se advierte una mayor probabilidad bot entre las cuentas que presentan intermediación o betweenness centrality e integran la red entre sí; pero también, una mayor probabilidad de marcaje de mensajes de favorito entre cuentas con mayor probabilidad bot.

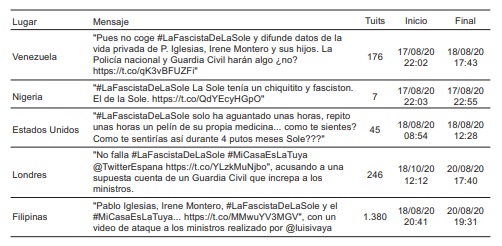

El análisis de geolocalización nos muestra cómo de los 14.702 tuits asociados a la etiqueta #LaFascistadelaSole, solo 5.039 se ubican en España (547 de ellos desde Madrid, 229 desde Asturias, 1.180 desde Málaga, 116 Sevilla, 289 Santander-Bilbao); mientras que 1707 tuits se geolocalizan en Filipinas, 246 en Londres, 270 en los Estados Unidos y 199 en Venezuela; quedando alrededor de un 30% de los mensajes sin posibilidad de estimarse su procedencia (tabla 2).

Tabla 2 Ejemplo de mensajes sobre #LaFascistaDeLaSole, geolocalizados fuera de España

Fuente. Elaborado por los autores.

La tabla 2 nos muestra que los mensajes emitidos y retuiteados fuera de España se caracterizan por promover contenidos confrontativos y polarizados, en los que, principalmente (desde supuestas cuentas de seguidores del partido Podemos), se intenta: buscar a una posible divulgadora de la ubicación; o acusar a supuestos miembros de los cuerpos de seguridad del Estado (ej.: Guardias Civiles) de increpar a los ministros (como los tuits geolocalizados desde Londres).

Perfiles de usuarios identificados

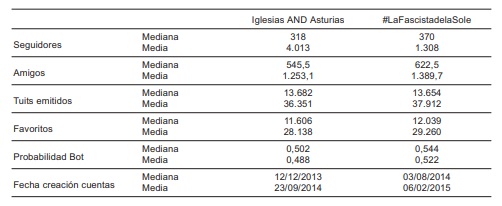

Un análisis de la naturaleza y comportamiento de los usuarios, involucrados en estas campañas, muestra la mediana y la media de alguno de los rasgos que caracterizan a las cuentas participantes en cada una de las tres fases estudiadas (ver tabla 3).

La tabla 3 nos permite ver cómo un bajo número de seguidores y amigos en las cuentas asociadas a los mensajes que integraron la muestra analizada en este trabajo. Por lo que podemos considerar que la mayoría de los usuarios relacionados con la viralización del debate tomado como caso de estudio, cumplen o tienen un perfil de tipo nano-influencers (menos de 10.000 seguidores), según Ong, Tapsell y Curato (2019), que alcanzan una difusión limitada pero que no presentan posibles rechazos, aunque todos ellos unidos logran alcanzar a muchos otros usuarios, más allá de sus seguidores y amigos, desde la aplicación de la estrategia astroturfing, tenida en consideración en este estudio.

La tabla 3 también permite apreciar una similitud entre cuentas, en la forma en cómo se comportan en Twitter, al observarse una gran actividad en esta red social, con decenas de miles de tuits emitidos o marcados como favoritos desde su creación. Lo que supone una actividad constante y diaria en Twitter muy intensa. Otro dato para resaltar es la media y la mediana de la fecha en que se crearon las cuentas participantes en las campañas, siendo muy semejantes entre sí, incluso de unos pocos días.

Determinación de la polarización de los mensajes

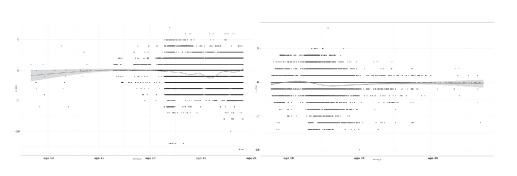

Un análisis temporal de los niveles de polarización de los mensajes, mostrados en la figura 4, muestran una cantidad de textos con unos niveles muy elevados, especialmente de tipo negativo. Puede observarse como, a lo largo del tiempo de las dos campañas, la media es siempre negativa llegando a valores de -2 a lo largo del día 19. Tomando como premisa que unos valores en una frase superiores a tres pueden considerarse como mensajes muy intensos, se encuentran algunos hasta niveles de -16 en el primero y -7 en el segundo, y valores positivos de +7 y +8 respectivamente, pero en una cantidad casi testimonial.

Fuente: Elaborado por los autores a través de R.

Figura 4 Polaridad de los tuits en función del tiempo en las campañas “Iglesias AND Asturias” (izquierda) y #LaFascistadelaSole (derecha)

Estos niveles de mensajes muy intensos pueden complementarse con los niveles de emociones básicas ligadas a los tuits. De esta forma en la campaña detectada con “Iglesias AND Asturias” tienen presencia de tristeza (20,3%), miedo (18,6%), asco (17,5%) y disgusto (16,3%). El resto de las emociones detectadas están por debajo del 8,5%. En cuanto a la campaña alrededor de #LaFascistadelaSole las emociones más presentes son confianza (16,4%), miedo (16,8%), tristeza (16,0%), disgusto (13,7%) y asco (13,6%). El resto de las emociones cae por debajo del 9%.

Estos valores de polaridad y de emociones vienen a mostrar un discurso, no solo muy polarizado, sino además muy intenso y emocional de sentimientos donde la tristeza, miedo y asco son elementos comunes y destacados. De esta forma, se estaría ante un discurso con mucha intensidad, muy partisano y de ataque. La emoción analizada en el estudio denominada como anticipación, ligada al pensamiento racional y elaborado, es escaso y no aparece casi entre las estudiadas, con una presencia del 8,5% y 7,9% respectivamente con cada campaña.

Conclusiones

El análisis del caso estudiado en este artículo, más allá del alcance de la viralización que tuvo a nivel nacional en España, ayuda a tener acceso a una serie de datos que nos permiten observar como el astroturfing, estaría siendo usado para condicionar la opinión pública, en nuestro caso a nivel de la sociedad española, desde acciones comunicativas digitales centradas en un supuesto marco de espontaneidad, en los términos expuestos por Niño González, Barquero Cabrero y García García (2017), Kovic et al. (2018) y Lits (2020). Algo que estaría dándose desde usuarios que no necesariamente son simples bots o se encuentran localizados en España, quienes, en un marco reducido de tiempo, publican y comparten mensajes que, bajo una aparente exposición aleatoria de mensajes, publicadas por cuentas con perfil nano-influencer, que distribuyen, amplifican e inundan redes sociales como Twitter con mensajes cargados con información sarcástica y/o falsa, que ayudan a la alteración del sentido de credibilidad colectiva online, como bien apuntan autores como Del Vicario et al. (2016). Un hecho que, alrededor del caso estudiado, toma un tema que, inicialmente, debería encontrarse dentro de la esfera privada de los personales receptores de esta campaña, que al final trasciende y se posiciona dentro del debate político español, durante el período analizado.

Pese a las limitaciones que implica el abordaje del tema propuesto, al centrarse en un debate asociado a un tema puntual, acontecido y relacionado con la esfera política nacional española, consideramos que los resultados mostrados en este trabajo dan visibilidad a la aplicación del astroturfing en contextos políticos no electorales, como los abordados por autores como Bastos y Marcea (2018) y otros expuestos en el apartado introductorio. Lo que ayudaría a entender cómo este tipo de estrategias, orientadas a la manipulación de la opinión pública desde las redes sociales, pudiesen estar asentándose a nivel español, en general. Sobre todo, alrededor de actores que hacen parte activa y diaria de la realidad política española, que pudiesen estar siendo objeto de este tipo de campañas de desinformación, impulsadas, no solo desde España, sino desde el extranjero, a través de usuarios con perfil micro o nano-influencers que ayudan a evitar la detección de posibles empresas que autores como Ong y Cabañes (2019) o Bradshaw, Bailey y Howard (2021), han destacado que hacen parte de una industria cada vez más floreciente, encargada de emitir contenidos coordinadamente.

Finalmente, las implicaciones de todo lo aquí expuesto, consideramos que también abriría un debate alrededor de la capacidad que tendrían iniciativas de detección (académicas y periodísticas) de contenido desinformativo, ante la dificultad que entrañaría la identificación de nano y micro-infuencers, quienes sacan provecho de su perfil para ocultarse entre la amplia diversidad de cuentas con características morfológicas similares. Unas cuentas que se alternan con otras (con alta probabilidad de ser bots) a lo largo de cada una de las fases (distribución, amplificación e inundación) puestas en marcha hasta el posicionamiento del tema de interés en la opinión pública, a través de este tipo de estrategia (astroturfing).